Mécanique 1 : cinématique linéaire et calcul >>

Chapitre 10

Sujets mathématiques

issus de la 3D graphique

Je ne pense pas qu’il y ait quoi que ce soit de mal à de belles images.

— Shigeru Miyamoto (1952–)

Ce chapitre traite d’un certain nombre de questions mathématiques qui surviennent lors de la création de graphismes 3D sur ordinateur. Bien sûr, nous ne pouvons pas espérer couvrir le vaste sujet de l’infographie en détail dans un seul chapitre. Des livres entiers sont écrits qui ne font que survoler le sujet. Ce chapitre est à l’infographie ce que ce livre entier est aux applications 3D interactives : il présente un aperçu extrêmement bref et de haut niveau du sujet, en se concentrant sur les sujets pour lesquels les mathématiques jouent un rôle essentiel. Comme dans le reste de ce livre, nous essayons d’accorder une attention particulière aux sujets qui, de notre expérience, sont traités superficiellement dans d’autres sources ou sont une source de confusion pour les débutants.

Pour être un peu plus direct : ce chapitre seul ne suffit pas pour vous apprendre à afficher de belles images à l’écran. Cependant, il devrait être utilisé en parallèle (ou avant !) un autre cours, livre ou auto-apprentissage sur l’infographie, et nous espérons qu’il vous aidera à surmonter facilement quelques obstacles traditionnels. Bien que nous présentions quelques extraits d’exemples en High Level Shading Language (HLSL) à la fin de ce chapitre, vous ne trouverez pas grand-chose d’autre pour vous aider à déterminer quels appels de fonctions DirectX ou OpenGL effectuer pour obtenir un effet désiré. Ces questions sont certainement d’une importance pratique capitale, mais hélas, elles appartiennent aussi à la catégorie des connaissances que Robert Maynard Hutchins qualifiait de « faits à vieillissement rapide », et nous avons essayé d’éviter d’écrire un livre qui nécessite une mise à jour tous les deux ans quand ATI sort une nouvelle carte ou Microsoft une nouvelle version de DirectX. Heureusement, les références et exemples d’API à jour abondent sur Internet, qui est un endroit beaucoup plus approprié pour ce genre de choses. (API signifie interface de programmation d’application. Dans ce chapitre, API désignera le logiciel que nous utilisons pour communiquer avec le sous-système de rendu.)

Une dernière mise en garde : comme il s’agit d’un livre sur les maths pour les jeux vidéo, nous aurons un biais vers le temps réel. Cela ne veut pas dire que le livre ne peut pas être utilisé si vous vous intéressez à l’écriture d’un lanceur de rayons ; seulement que notre expertise et notre focus se situe dans le rendu en temps réel.

Ce chapitre progresse grosso modo de la théorie en tour d’ivoire aux extraits de code concrets.

La Section 10.1 donne une approche théorique très générale (et sophistiquée) de l’infographie, aboutissant à l’équation de rendu.

Nous baissons ensuite notre niveau d’abstraction pour nous concentrer sur des questions d’application pratique plus directe, tout en maintenant notre indépendance vis-à-vis des plates-formes et en essayant de rester pertinents dans dix ans.

La Section 10.2 traite de quelques mathématiques de base liées à la visualisation en 3D.

La Section 10.3 introduit quelques espaces de coordonnées et transformations importants.

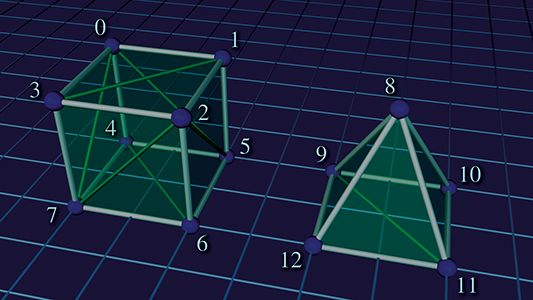

La Section 10.4 examine comment représenter les surfaces de la géométrie de notre scène à l’aide d’un maillage polygonal.

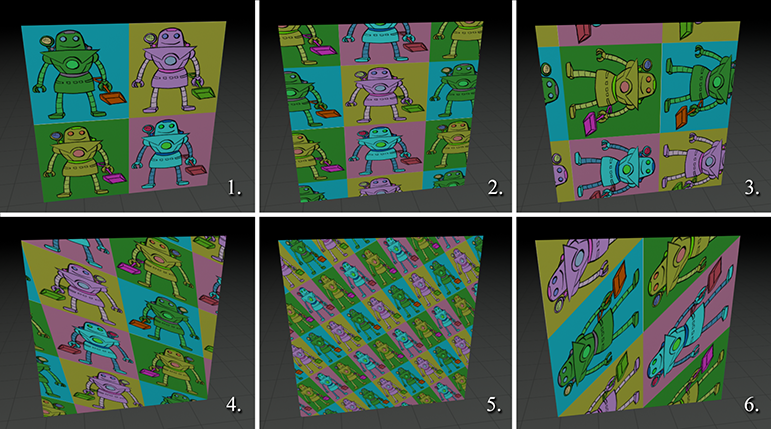

La Section 10.5 montre comment contrôler les propriétés des matériaux (comme la « couleur » de l’objet) à l’aide de cartes de texture.

Les sections suivantes portent sur l’éclairage.

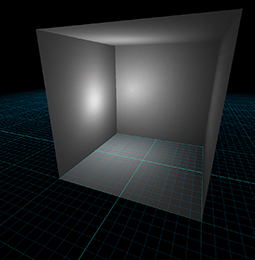

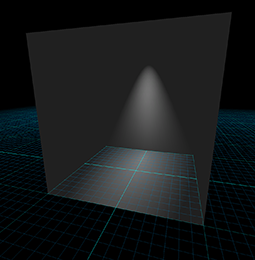

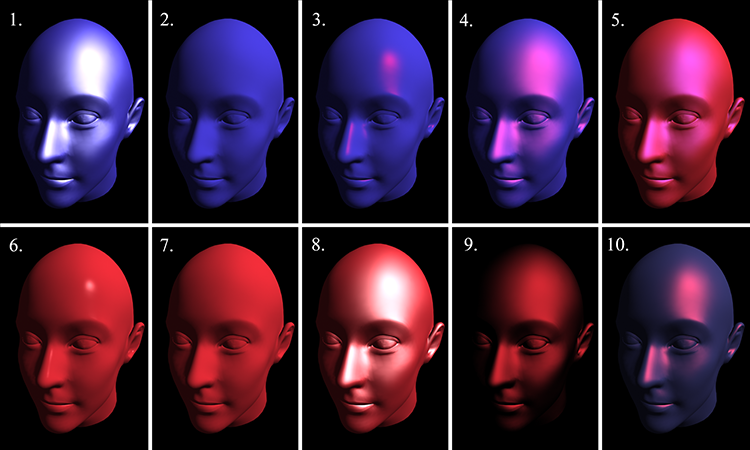

La Section 10.6 définit l’omniprésent modèle d’éclairage de Blinn-Phong.

La Section 10.7 discute de quelques méthodes courantes pour représenter les sources lumineuses.

En s’éloignant un peu plus de la théorie intemporelle, les sections suivantes discutent de deux questions d’intérêt contemporain particulier.

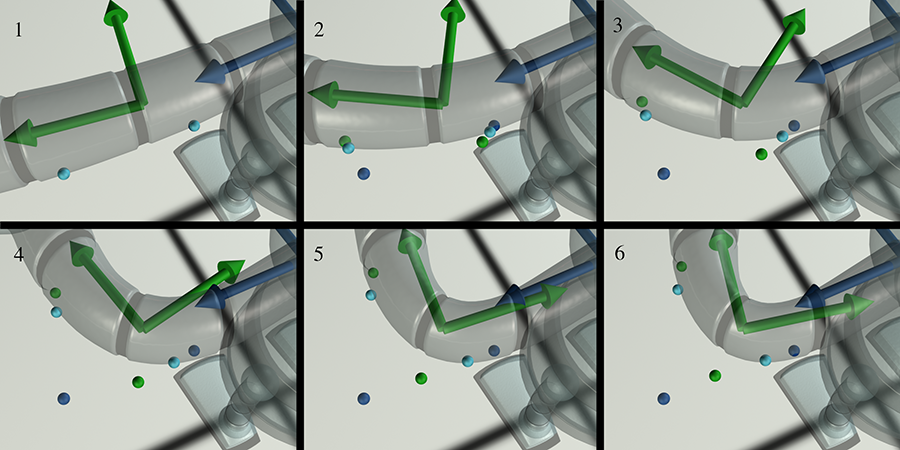

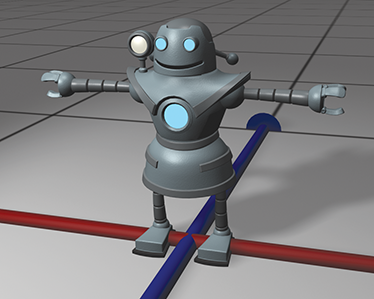

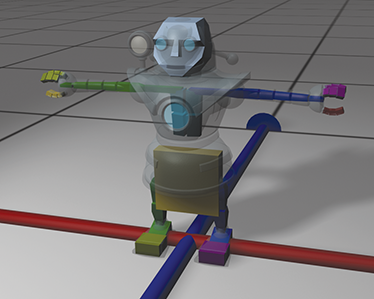

La Section 10.8 porte sur l’animation squelettique.

La Section 10.9 explique le fonctionnement du bump mapping.

Le dernier tiers de ce chapitre est le plus susceptible de devenir obsolète dans les années à venir, car il est le plus immédiatement pratique.

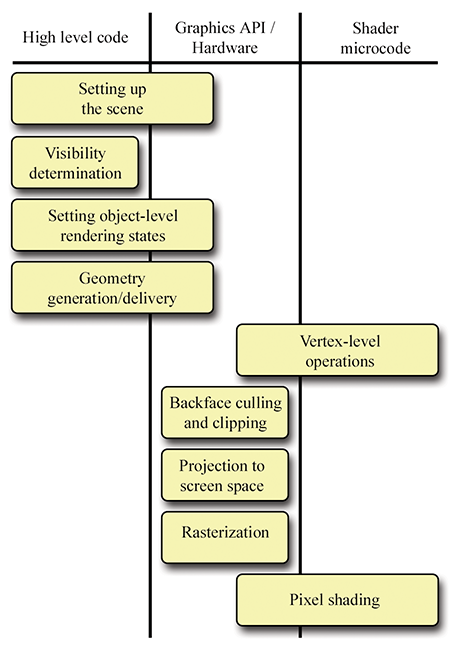

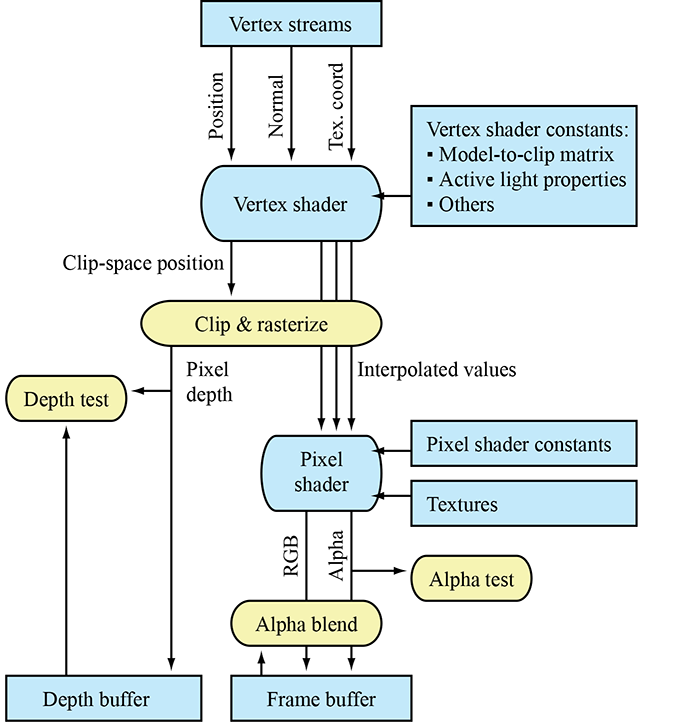

La Section 10.10 donne un aperçu d’un pipeline graphique temps réel simple, puis descend ce pipeline en abordant certaines questions mathématiques en chemin.

La Section 10.11 conclut le chapitre en plein territoire des « faits à vieillissement rapide » avec plusieurs exemples HLSL illustrant certaines des techniques abordées précédemment.

10.1Fonctionnement de l’infographie

Nous commençons notre discussion de l’infographie en vous expliquant comment les choses fonctionnent vraiment, ou peut-être plus précisément, comment elles devraient vraiment fonctionner, si nous avions suffisamment de connaissances et de puissance de traitement pour faire les choses correctement. L’étudiant débutant est averti que beaucoup de matériel introductif (surtout les tutoriels sur Internet) et la documentation d’API souffrent d’un grand manque de perspective. Vous pourriez avoir l’impression en lisant ces sources que les diffuse maps, l’ombrage de Blinn-Phong et l’occlusion ambiante sont « La façon dont les images du monde réel fonctionnent », alors qu’en réalité vous lisez probablement une description de la façon dont un modèle d’éclairage particulier a été implémenté dans un langage particulier sur un matériel particulier via une API particulière. En définitive, tout tutoriel entrant dans les détails doit choisir un modèle d’éclairage, un langage, une plate-forme, une représentation des couleurs, des objectifs de performance, etc. — comme nous devrons le faire plus loin dans ce chapitre. (Ce manque de perspective est généralement intentionnel et justifié.) Cependant, nous pensons qu’il est important de savoir quels sont les principes fondamentaux et intemporels, et quels sont les choix arbitraires basés sur des approximations et des compromis, guidés par des limitations technologiques qui peuvent n’être applicables qu’au rendu en temps réel, ou susceptibles de changer dans un avenir proche. Donc avant d’entrer trop dans les détails du type particulier de rendu le plus utile pour l’infographie temps réel introductive, nous voulons décrire comment le rendu fonctionne vraiment.

Nous nous empressons également d’ajouter que cette discussion suppose que l’objectif est le photoréalisme, simulant le fonctionnement des choses dans la nature. En fait, ce n’est souvent pas l’objectif, et ce n’est certainement jamais le seul objectif. Comprendre comment la nature fonctionne est un point de départ très important, mais des facteurs artistiques et pratiques dictent souvent une stratégie différente de la simple simulation de la nature.

10.1.1Les deux grandes approches du rendu

Nous commençons avec la fin en tête. L’objectif final du rendu est un bitmap, ou peut-être une séquence de bitmaps si nous produisons une animation. Vous savez presque certainement déjà qu’un bitmap est un tableau rectangulaire de couleurs, et chaque entrée de la grille est connue sous le nom de pixel, qui est l’abréviation de « picture element » (élément d’image). Au moment où nous produisons l’image, ce bitmap est également connu sous le nom de tampon de trame (frame buffer), et souvent il y a un post-traitement ou une conversion supplémentaire lorsque nous copions le tampon de trame vers la sortie bitmap finale.

Comment déterminons-nous la couleur de chaque pixel ? C’est la question fondamentale du rendu. Comme tant de défis en informatique, un excellent point de départ est d’examiner comment la nature fonctionne.

Nous voyons la lumière. L’image que nous percevons est le résultat de la lumière qui rebondit dans l’environnement et entre finalement dans l’œil. Ce processus est compliqué, pour le moins. Non seulement la physique1 de la lumière rebondissant est très compliquée, mais il en va de même pour la physiologie de l’équipement de détection dans nos yeux2 et les mécanismes d’interprétation dans nos esprits. Ainsi, en ignorant un grand nombre de détails et de variations (comme tout livre introductif doit le faire), la question de base à laquelle tout système de rendu doit répondre pour chaque pixel est « Quelle couleur de lumière s’approche de la caméra depuis la direction correspondant à ce pixel ? »

Il y a essentiellement deux cas à considérer. Soit nous regardons directement une source lumineuse et la lumière a voyagé directement de la source lumineuse à notre œil, soit (plus couramment) la lumière est partie d’une source lumineuse dans une autre direction, a rebondi une ou plusieurs fois, puis est entrée dans notre œil. Nous pouvons décomposer la question clé posée précédemment en deux tâches. Ce livre appelle ces deux tâches l’algorithme de rendu, bien que ces deux procédures hautement abstraites cachent évidemment une grande complexité concernant les algorithmes réels utilisés en pratique pour les implémenter.

L’algorithme de rendu

Détermination de la surface visible. Trouver la surface la plus proche de l’œil, dans la direction correspondant au pixel actuel.

Éclairage. Déterminer quelle lumière est émise et/ou réfléchie par cette surface dans la direction de l’œil.

À ce stade, il semble que nous ayons fait quelques simplifications importantes, et beaucoup d’entre vous lèvent sans doute leur main métaphorique pour demander « Qu’en est-il de la translucidité ? » « Qu’en est-il des réflexions ? » « Qu’en est-il de la réfraction ? » « Qu’en est-il des effets atmosphériques ? » Veuillez retenir toutes les questions jusqu’à la fin de la présentation.

La première étape de l’algorithme de rendu est connue sous le nom de détermination de la surface visible. Il existe deux solutions courantes à ce problème. La première est connue sous le nom de lancer de rayons (raytracing). Plutôt que de suivre les rayons lumineux dans la direction dans laquelle ils voyagent depuis les surfaces émissives, nous traçons les rayons à rebours, de sorte que nous ne traitons que les rayons lumineux qui comptent : ceux qui entrent dans notre œil depuis la direction donnée. Nous envoyons un rayon depuis l’œil dans la direction passant par le centre de chaque pixel3 pour voir le premier objet de la scène que ce rayon frappe. Ensuite, nous calculons la couleur émise ou réfléchie par cette surface dans la direction du rayon. Un résumé très simplifié de cet algorithme est illustré par le Listing 10.1.

for (each x,y screen pixel) {

// Sélectionner un rayon pour ce pixel

Ray ray = getRayForPixel(x,y);

// Intersecter le rayon avec la géométrie. Cela ne retournera

// pas seulement le point d'intersection, mais aussi une normale

// de surface et d'autres informations nécessaires pour ombrer

// le point, comme une référence d'objet, des informations de

// matériau, des coordonnées locales S,T, etc.

// Ne pas prendre ce pseudocode trop littéralement.

Vector3 pos, normal;

Object *obj; Material *mtl;

if (rayIntersectScene(ray, pos, normal, obj, mtl)) {

// Ombrer le point d'intersection. (Quelle lumière est

// émise/réfléchie depuis ce point vers la caméra ?)

Color c = shadePoint(ray, pos, normal, obj, mtl);

// Le mettre dans le tampon de trame

writeFrameBuffer(x,y, c);

} else {

// Le rayon a manqué toute la scène. Utiliser simplement une

// couleur de fond générique pour ce pixel

writeFrameBuffer(x,y, backgroundColor);

}

}L’autre stratégie principale pour la détermination de la surface visible, celle utilisée pour le rendu en temps réel au moment de la rédaction de ce texte, est connue sous le nom de tampon de profondeur (depth buffering). L’idée de base est qu’à chaque pixel nous stockons non seulement une valeur de couleur, mais aussi une valeur de profondeur. Cette valeur de tampon de profondeur enregistre la distance de l’œil à la surface qui réfléchit ou émet la lumière utilisée pour déterminer la couleur de ce pixel. Comme illustré dans le Listing 10.1, la « boucle externe » d’un lanceur de rayons est les pixels en espace écran, mais dans les graphismes temps réel, la « boucle externe » est les éléments géométriques qui constituent la surface de la scène.

Les différentes méthodes de description des surfaces ne sont pas importantes ici. Ce qui est important, c’est que nous pouvons projeter la surface sur l’espace écran et les mapper sur les pixels de l’espace écran via un processus connu sous le nom de rastérisation. Pour chaque pixel de la surface, connu sous le nom de fragment source, nous calculons la profondeur de la surface à ce pixel et la comparons à la valeur existante dans le tampon de profondeur, parfois connu sous le nom de fragment destination. Si le fragment source que nous sommes en train de rendre est plus loin de la caméra que la valeur existante dans le tampon, alors ce que nous avons rendu avant ceci cache la surface que nous rendons maintenant (du moins à ce pixel), et nous passons au pixel suivant. Cependant, si notre valeur de profondeur est plus proche que la valeur existante dans le tampon de profondeur, alors nous savons que c’est la surface la plus proche de l’œil (du moins parmi celles rendues jusqu’à présent) et donc nous mettons à jour le tampon de profondeur avec cette nouvelle valeur de profondeur plus proche. À ce stade, nous pourrions également passer à l’étape 2 de l’algorithme de rendu (du moins pour ce pixel) et mettre à jour le tampon de trame avec la couleur de la lumière émise ou réfléchie par la surface à ce point. C’est connu sous le nom de rendu avant (forward rendering), et l’idée de base est illustrée par le Listing 10.2.

// Effacer les tampons de trame et de profondeur

fillFrameBuffer(backgroundColor);

fillDepthBuffer(infinity);

// La boucle externe itère sur toutes les primitives (généralement des triangles)

for (each geometric primitive) {

// Rastériser la primitive

for (each pixel x,y in the projection of the primitive) {

// Tester le tampon de profondeur, pour voir si un pixel plus

// proche a déjà été écrit.

float primDepth = getDepthOfPrimitiveAtPixel(x,y);

if (primDepth > readDepthBuffer(x,y)) {

// Le pixel de cette primitive est caché, l'ignorer

continue;

}

// Déterminer la couleur de la primitive à ce pixel.

Color c = getColorOfPrimitiveAtPixel(x,y);

// Mettre à jour les tampons de couleur et de profondeur

writeFrameBuffer(x,y, c);

writeDepthBuffer(x,y, primDepth);

}

}À l’opposé du rendu avant se trouve le rendu différé (deferred rendering), une ancienne technique qui redevient populaire en raison de l’emplacement actuel des goulots d’étranglement dans les types d’images que nous produisons et le matériel que nous utilisons pour les produire. Un moteur de rendu différé utilise, en plus du tampon de trame et du tampon de profondeur, des tampons supplémentaires, collectivement connus sous le nom de G-buffer (abréviation de tampon de géométrie), qui contient des informations supplémentaires sur la surface la plus proche de l’œil à cet emplacement, comme la position 3D de la surface, la normale de surface, et les propriétés de matériau nécessaires pour les calculs d’éclairage, comme la « couleur » de l’objet et son niveau de « brillance » à cet emplacement particulier. (Plus tard, nous verrons comment ces termes intuitifs entre guillemets sont un peu trop vagues pour le rendu.) Par rapport à un moteur de rendu avant, un moteur de rendu différé suit notre algorithme de rendu en deux étapes un peu plus littéralement. D’abord, nous « rendons » la scène dans le G-buffer, effectuant essentiellement uniquement la détermination de la visibilité — récupérant les propriétés de matériau du point « vu » par chaque pixel mais n’effectuant pas encore les calculs d’éclairage. La seconde passe effectue réellement les calculs d’éclairage. Le Listing 10.3 explique le rendu différé en pseudocode.

// Effacer les tampons de géométrie et de profondeur

clearGeometryBuffer();

fillDepthBuffer(infinity);

// Rastériser toutes les primitives dans le G-buffer

for (each geometric primitive) {

for (each pixel x,y in the projection of the primitive) {

// Tester le tampon de profondeur, pour voir si un pixel plus

// proche a déjà été écrit.

float primDepth = getDepthOfPrimitiveAtPixel(x,y);

if (primDepth > readDepthBuffer(x,y)) {

// Le pixel de cette primitive est caché, l'ignorer

continue;

}

// Récupérer les informations nécessaires pour l'ombrage dans

// la passe suivante.

MaterialInfo mtlInfo;

Vector3 pos, normal;

getPrimitiveShadingInfo(mtlInfo, pos, normal);

// Les sauvegarder dans le G-buffer et le tampon de profondeur

writeGeometryBuffer(x,y, mtlInfo, pos, normal);

writeDepthBuffer(x,y, primDepth);

}

}

// Effectuer maintenant l'ombrage dans une 2e passe, en espace écran

for (each x,y screen pixel) {

if (readDepthBuffer(x,y) == infinity) {

// Pas de géométrie ici. Écrire simplement une couleur de fond

writeFrameBuffer(x,y, backgroundColor);

} else {

// Récupérer les informations d'ombrage depuis le tampon de géométrie

MaterialInfo mtlInfo;

Vector3 pos, normal;

readGeometryBuffer(x,y, mtlInfo, pos, normal);

// Ombrer le point

Color c = shadePoint(pos, normal, mtlInfo);

// Le mettre dans le tampon de trame

writeFrameBuffer(x,y, c);

}

}Pseudocode pour le rendu différé utilisant le tampon de profondeur

Avant de continuer, nous devons mentionner un point important sur les raisons pour lesquelles le rendu différé est populaire. Lorsque plusieurs sources lumineuses éclairent le même point de surface, les limitations matérielles ou les facteurs de performance peuvent nous empêcher de calculer la couleur finale d’un pixel en un seul calcul, comme le montrent les listes de pseudocode pour les rendus avant et différé. Au lieu de cela, nous devons utiliser plusieurs passes, une passe pour chaque lumière, et accumuler la lumière réfléchie de chaque source lumineuse dans le tampon de trame. Dans le rendu avant, ces passes supplémentaires impliquent de rendre à nouveau les primitives. Avec le rendu différé, cependant, les passes supplémentaires sont en espace image, et dépendent donc de la taille 2D de la lumière en espace écran, pas de la complexité de la scène ! C’est dans cette situation que le rendu différé commence vraiment à avoir de grands avantages de performance par rapport au rendu avant.

10.1.2Description des propriétés de surface : la BRDF

Parlons maintenant de la deuxième étape de l’algorithme de rendu : l’éclairage. Une fois que nous avons localisé la surface la plus proche de l’œil, nous devons déterminer la quantité de lumière émise directement par cette surface, ou émise depuis une autre source et réfléchie par la surface dans la direction de l’œil. La lumière transmise directement d’une surface à l’œil — par exemple, lorsqu’on regarde directement une ampoule ou le soleil — est le cas le plus simple. Ces surfaces émissives sont une petite minorité dans la plupart des scènes ; la plupart des surfaces n’émettent pas leur propre lumière, mais réfléchissent plutôt la lumière émise depuis ailleurs. Nous concentrerons l’essentiel de notre attention sur les surfaces non-émissives.

Bien que nous parlions souvent informellement de la « couleur » d’un objet, nous savons que la couleur perçue d’un objet est en réalité la lumière qui entre dans notre œil, et peut donc dépendre de nombreux facteurs différents. Les questions importantes à poser sont : Quelles couleurs de lumière sont incidentes sur la surface, et depuis quelles directions ? Depuis quelle direction regardons-nous la surface ? Comment l’objet est-il « brillant » ?4 Donc une description d’une surface adaptée au rendu ne répond pas à la question « De quelle couleur est cette surface ? » Cette question est parfois dénuée de sens — de quelle couleur est un miroir, par exemple ? Au lieu de cela, la question pertinente est un peu plus compliquée, et elle ressemble à ceci : « Lorsque la lumière d’une couleur donnée frappe la surface depuis une direction incidente donnée, quelle fraction de cette lumière est réfléchie dans une autre direction particulière ? » La réponse à cette question est donnée par la fonction de distribution de réflectance bidirectionnelle, ou BRDF en abrégé. Donc plutôt que « De quelle couleur est l’objet ? » nous demandons « Quelle est la distribution de la lumière réfléchie ? »

Symboliquement, nous écrivons la BRDF comme la fonction .5 La valeur de cette fonction est un scalaire qui décrit la probabilité relative que la lumière incidente au point depuis la direction soit réfléchie dans la direction sortante plutôt que dans une autre direction sortante. Comme indiqué par le type en gras et le chapeau, peut être un vecteur unitaire, mais plus généralement, il peut s’agir de n’importe quelle façon de spécifier une direction ; les angles polaires sont un autre choix évident et sont couramment utilisés. Différentes couleurs de lumière sont généralement réfléchies différemment ; d’où la dépendance à , qui est la couleur (en réalité, la longueur d’onde) de la lumière.

Bien que nous nous intéressions particulièrement aux directions incidentes qui proviennent de surfaces émissives et aux directions sortantes qui pointent vers notre œil, en général, toute la distribution est pertinente. Premièrement, les lumières, les yeux et les surfaces peuvent se déplacer, donc dans le contexte de la création d’une description de surface (par exemple, « cuir rouge »), nous ne savons pas quelles directions seront importantes. Mais même dans une scène particulière avec toutes les surfaces, lumières et yeux fixes, la lumière peut rebondir plusieurs fois, nous devons donc mesurer les réflexions lumineuses pour des paires arbitraires de directions.

Avant de continuer, il est très instructif de voir comment les deux propriétés intuitives de matériau qui ont été décriées précédemment, la couleur et la brillance, peuvent être exprimées précisément dans le cadre d’une BRDF. Considérons une balle verte. Un objet vert est vert et non bleu car il réfléchit la lumière incidente verte plus fortement que la lumière incidente de toute autre couleur.6 Par exemple, peut-être que la lumière verte est presque entièrement réfléchie, avec seulement une petite fraction absorbée, tandis que 95% de la lumière bleue et rouge est absorbée et seulement 5% de la lumière à ces longueurs d’onde est réfléchie dans diverses directions. La lumière blanche consiste en réalité en toutes les différentes couleurs de lumière, donc un objet vert filtre essentiellement les couleurs autres que le vert. Si un autre objet répondait à la lumière verte et rouge de la même manière que notre balle verte, mais absorbait 50% de la lumière bleue et réfléchissait les autres 50%, nous pourrions percevoir l’objet comme bleu-vert (teal). Ou si la plupart de la lumière à toutes les longueurs d’onde était absorbée, sauf une petite quantité de lumière verte, nous la percevrions comme une teinte foncée de vert. En résumé, une BRDF rend compte de la différence de couleur entre deux objets à travers la dépendance à : toute longueur d’onde de lumière donnée a sa propre distribution de réflectance.

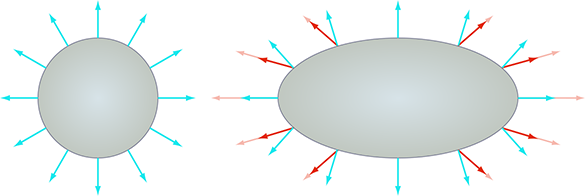

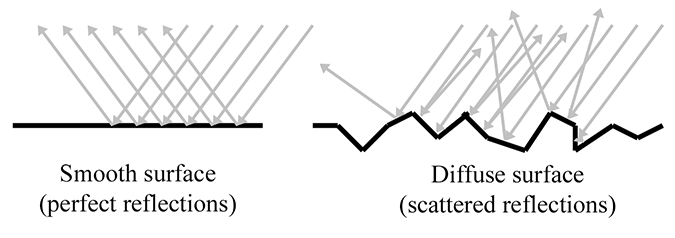

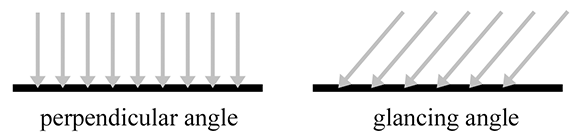

Ensuite, considérons la différence entre du plastique rouge brillant et du papier de construction rouge mat. Une surface brillante réfléchit la lumière incidente beaucoup plus fortement dans une direction particulière par rapport aux autres, alors qu’une surface diffuse disperse la lumière plus uniformément dans toutes les directions sortantes. Un réflecteur parfait, comme un miroir, réfléchirait toute la lumière d’une direction entrante dans une seule direction sortante, tandis qu’une surface parfaitement diffuse réfléchirait la lumière également dans toutes les directions sortantes, quelle que soit la direction d’incidence. En En résumé, une BRDF rend compte de la différence de « brillance » entre deux objets à travers sa dépendance à et .

Des phénomènes plus complexes peuvent être exprimés en généralisant la BRDF. La translucidité et la réfraction de la lumière peuvent être facilement incorporées en permettant aux vecteurs de direction de pointer vers l’intérieur de la surface. Nous pourrions appeler cette généralisation mathématique une fonction de distribution de dispersion de surface bidirectionnelle (BSSDF). Parfois, la lumière frappe un objet, rebondit à l’intérieur de celui-ci, puis en ressort à un point différent. Ce phénomène est connu sous le nom de diffusion sous-surface et est un aspect important de l’apparence de nombreuses substances communes, comme la peau et le lait. Cela nécessite de diviser le point de réflexion unique en et , ce qui est utilisé par la fonction de distribution de dispersion de surface bidirectionnelle (BSSDF). Même les effets volumétriques, comme le brouillard et la diffusion sous-surface, peuvent être exprimés, en supprimant le mot « surface » et en définissant une fonction de distribution de dispersion bidirectionnelle (BSDF) en tout point de l’espace, pas seulement sur les « surfaces ». Au premier abord, cela peut sembler être des abstractions impratiques, mais elles peuvent être utiles pour comprendre comment concevoir des outils pratiques.

Au passage, certains critères doivent être satisfaits par une BRDF pour être physiquement plausible. Premièrement, il n’est pas logique qu’une quantité négative de lumière soit réfléchie dans une direction quelconque. Deuxièmement, il n’est pas possible que la lumière totale réfléchie soit supérieure à la lumière incidente, bien que la surface puisse absorber une certaine énergie, de sorte que la lumière réfléchie peut être inférieure à la lumière incidente. Cette règle est généralement appelée la contrainte de normalisation. Un dernier principe, moins évident, respecté par les surfaces physiques est la réciprocité de Helmholtz : si nous choisissons deux directions arbitraires, la même fraction de lumière doit être réfléchie, quelle que soit la direction incidente et quelle que soit la direction sortante. En d’autres termes,

Réciprocité de Helmholtz

En raison de la réciprocité de Helmholtz, certains auteurs n’étiquettent pas les deux directions de la BRDF comme « entrante » et « sortante » car pour être physiquement plausible, le calcul doit être symétrique.

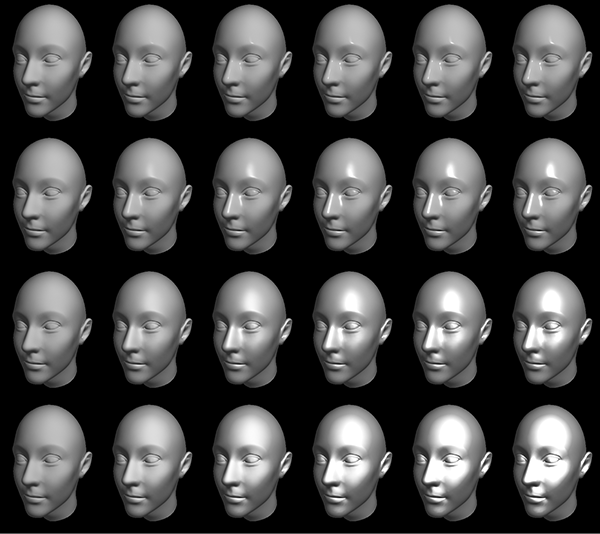

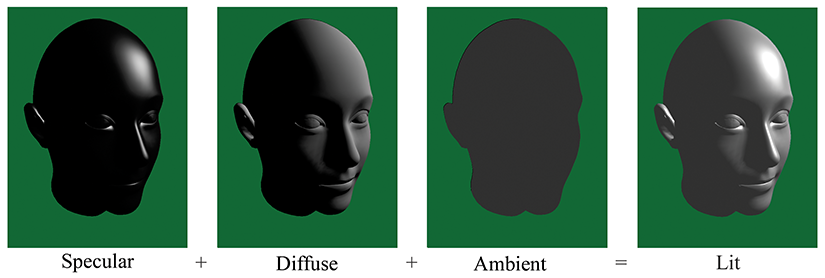

La BRDF contient la description complète de l’apparence d’un objet à un point donné, car elle décrit comment la surface réfléchira la lumière à ce point. Il est clair qu’une réflexion approfondie doit être consacrée à la conception de cette fonction. De nombreux modèles d’éclairage ont été proposés au cours des dernières décennies, et ce qui est surprenant est que l’un des premiers modèles, Blinn-Phong, est encore largement utilisé dans les graphismes temps réel aujourd’hui. Bien qu’il ne soit pas physiquement précis (ni plausible : il viole la contrainte de normalisation), nous l’étudions parce que c’est une bonne étape pédagogique et un élément important de l’histoire de l’infographie. En fait, qualifier Blinn-Phong d’« histoire » est du wishful thinking — peut-être la raison la plus importante d’étudier ce modèle est qu’il est encore si largement utilisé ! En fait, c’est le meilleur exemple du phénomène que nous avons mentionné au début de ce chapitre : des méthodes particulières présentées comme si elles étaient « la façon dont l’infographie fonctionne ».

Différents modèles d’éclairage ont différents objectifs. Certains sont meilleurs pour simuler des surfaces rugueuses, d’autres des surfaces avec plusieurs strates. Certains se concentrent sur la fourniture de « curseurs » intuitifs pour les artistes à contrôler, sans se préoccuper de savoir si ces curseurs ont une signification physique. D’autres sont basés sur la prise de surfaces réelles et leur mesure avec des caméras spéciales appelées goniophotomètres, en échantillonnant essentiellement la BRDF puis en utilisant l’interpolation pour reconstruire la fonction à partir des données tabulées. Le notable modèle Blinn-Phong discuté à la Section 10.6 est utile car il est simple, peu coûteux et bien compris des artistes. Consultez les sources dans la lecture suggérée pour un aperçu des modèles d’éclairage.

10.1.3Brève introduction à la colorimétrie et à la radiométrie

L’infographie consiste à mesurer la lumière, et vous devriez être conscient de certaines subtilités importantes, même si nous n’aurons pas le temps d’entrer dans tous les détails ici. La première concerne la façon de mesurer la couleur de la lumière, et la seconde la façon de mesurer sa luminosité.

Dans vos cours de sciences au collège, vous avez peut-être appris que chaque couleur de lumière est un mélange de lumière rouge, verte et bleue (RVB). C’est la conception populaire de la lumière, mais ce n’est pas tout à fait correct. La lumière peut prendre n’importe quelle fréquence unique dans la bande visible, ou elle peut être une combinaison de n’importe quel nombre de fréquences. La couleur est un phénomène de perception humaine et n’est pas tout à fait la même chose que la fréquence. En effet, différentes combinaisons de fréquences de lumière peuvent être perçues comme la même couleur — celles-ci sont connues sous le nom de métamères. Les combinaisons infinies de fréquences de lumière ressemblent un peu à tous les différents accords pouvant être joués sur un piano (et aussi les tons entre les touches). Dans cette métaphore, notre perception des couleurs est incapable de distinguer toutes les différentes notes individuelles, mais au lieu de cela, tout accord donné nous semble être une combinaison d’un do médian, d’un fa et d’un sol. Trois canaux de couleur n’est pas un nombre magique en ce qui concerne la physique ; c’est particulier à la vision humaine. La plupart des autres mammifères n’ont que deux types différents de récepteurs (nous les appellerions « daltoniens »), et les poissons, les reptiles et les oiseaux ont quatre types de récepteurs de couleur (ils nous appelleraient daltoniens).

Cependant, même les systèmes de rendu les plus avancés projettent le spectre continu de la lumière visible sur une base discrète, le plus souvent la base RVB. C’est une simplification omniprésente, mais nous voulions tout de même vous faire savoir que c’est une simplification, car elle ne rend pas compte de certains phénomènes. La base RVB n’est pas le seul espace colorimétrique, ni nécessairement le meilleur pour de nombreux objectifs, mais c’est une base très commode car c’est celle utilisée par la plupart des dispositifs d’affichage. À son tour, la raison pour laquelle cette base est utilisée par tant de dispositifs d’affichage est due à la similarité avec notre propre système visuel. Hall [11] décrit bien les lacunes du système RVB.

Étant donné que la partie visible du spectre électromagnétique est continue, une expression telle que est continue en termes de . Du moins, elle devrait l’être en théorie. En pratique, parce que nous produisons des images pour la consommation humaine, nous réduisons le nombre infini de différents à trois longueurs d’onde particulières. Habituellement, nous choisissons les trois longueurs d’onde comme celles perçues comme les couleurs rouge, verte et bleue. En pratique, vous pouvez considérer la présence de dans une équation comme un entier qui sélectionne lequel des trois « canaux de couleur » discrets est en cours de traitement.

Points clés sur la couleur

Décrire la distribution spectrale de la lumière nécessite une fonction continue, pas seulement trois nombres. Cependant, pour décrire la perception humaine de cette lumière, trois nombres sont essentiellement suffisants.

Le système RVB est un espace colorimétrique pratique, mais ce n’est pas le seul, et pas même le meilleur pour de nombreux objectifs pratiques. En pratique, nous traitons généralement la lumière comme étant une combinaison de rouge, vert et bleu car nous créons des images pour la consommation humaine.

Vous devriez également être conscient des différentes façons dont nous pouvons mesurer l’intensité de la lumière. Si nous adoptons un point de vue de la physique, nous considérons la lumière comme de l’énergie sous forme de rayonnement électromagnétique, et nous utilisons des unités de mesure du domaine de la radiométrie. La quantité la plus élémentaire est l’énergie rayonnante, qui dans le système SI est mesurée dans l’unité standard d’énergie, le joule (J). Tout comme tout autre type d’énergie, nous nous intéressons souvent au taux de flux d’énergie par unité de temps, qui est connu sous le nom de puissance. Dans le système SI, la puissance est mesurée en watts (W), ce qui est un joule par seconde (1 W = 1 J/s). La puissance sous forme de rayonnement électromagnétique est appelée puissance rayonnante ou flux radiant. Le terme « flux », qui vient du latin fluxus pour « écoulement », désigne une certaine quantité qui s’écoule à travers une certaine surface transversale. Ainsi, le flux radiant mesure la quantité totale d’énergie qui arrive, quitte ou traverse une certaine surface par unité de temps.

Imaginez qu’une certaine quantité de flux radiant soit émise par une surface de , tandis que cette même quantité de puissance est émise par une surface différente de . Clairement, la plus petite surface est « plus lumineuse » que la grande ; plus précisément, elle a un flux plus grand par unité de surface, également connu sous le nom de densité de flux. Le terme radiométrique pour la densité de flux, le flux radiant par unité de surface, est appelé radiosité, et dans le système SI il est mesuré en watts par mètre. La relation entre flux et radiosité est analogue à la relation entre force et pression ; confondre les deux mènera à des erreurs conceptuelles similaires.

Plusieurs termes équivalents existent pour la radiosité. Premièrement, notez que nous pouvons mesurer la densité de flux (ou le flux total, d’ailleurs) à travers n’importe quelle surface transversale. Nous pourrions mesurer la puissance rayonnante émise par une surface d’aire finie, ou la surface à travers laquelle la lumière s’écoule pourrait être une frontière imaginaire qui n’existe que mathématiquement (par exemple, la surface d’une sphère imaginaire qui entoure une source lumineuse). Bien que dans tous les cas nous mesurions la densité de flux, et donc le terme « radiosité » est tout à fait valide, nous pourrions également utiliser des termes plus spécifiques, selon que la lumière mesurée arrive ou part. Si la surface est une surface et que la lumière arrive sur la surface, le terme irradiance est utilisé. Si la lumière est émise par une surface, le terme exitance rayonnante ou émittance rayonnante est utilisé. Dans la synthèse d’images numériques, le mot « radiosité » est le plus souvent utilisé pour désigner la lumière qui quitte une surface, ayant été réfléchie ou émise.

Lorsque nous parlons de la luminosité en un point particulier, nous ne pouvons pas utiliser simplement la puissance rayonnante ordinaire car l’aire de ce point est infinitésimale (essentiellement nulle). Nous pouvons parler de la densité de flux en un seul point, mais pour mesurer le flux, nous avons besoin d’une aire finie sur laquelle mesurer. Pour une surface d’aire finie, si nous avons un seul nombre qui caractérise le total pour toute la surface, il sera mesuré en flux, mais pour capturer le fait que différents emplacements au sein de cette aire peuvent être plus lumineux que d’autres, nous utilisons une fonction qui varie sur la surface et qui mesurera la densité de flux.

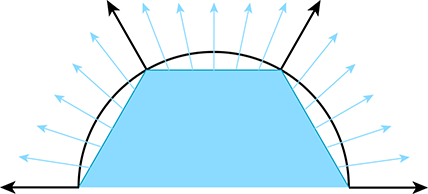

Nous sommes maintenant prêts à considérer ce qui est peut-être la quantité la plus centrale que nous devons mesurer en infographie : l’intensité d’un « rayon » de lumière. Nous pouvons voir pourquoi la radiosité n’est pas l’unité appropriée en étendant les idées du paragraphe précédent. Imaginez un point de surface entouré d’un dôme émissif recevant une certaine quantité d’irradiance provenant de toutes les directions dans l’hémisphère centré sur la normale de surface locale. Imaginez maintenant un deuxième point de surface subissant la même quantité d’irradiance, mais toute l’illumination provient d’une seule direction, dans un faisceau très mince. Intuitivement, nous pouvons voir qu’un rayon le long de ce faisceau est d’une certaine façon « plus lumineux » que n’importe quel rayon illuminant le premier point de surface. L’irradiance est d’une certaine façon « plus dense ». Elle est plus dense par unité d’angle solide.

L’idée d’un angle solide est probablement nouvelle pour certains lecteurs, mais nous pouvons facilement comprendre l’idée en la comparant aux angles dans le plan. Un angle « ordinaire » est mesuré (en radians) sur la base de la longueur de sa projection sur le cercle unitaire. De la même manière, un angle solide mesure l’aire projetée sur la sphère unitaire entourant le point. L’unité SI de l’angle solide est le stéradian, abrégé « sr ». La sphère complète a sr ; un hémisphère englobe sr.

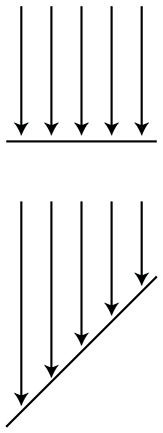

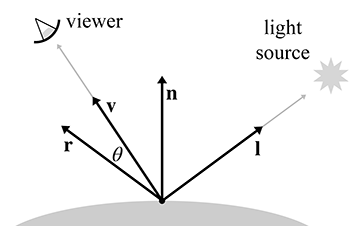

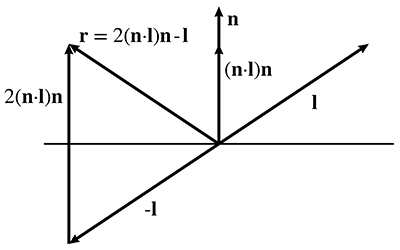

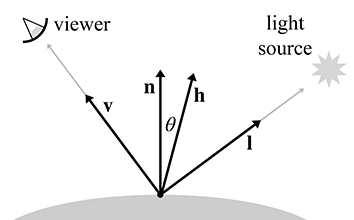

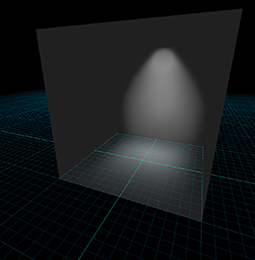

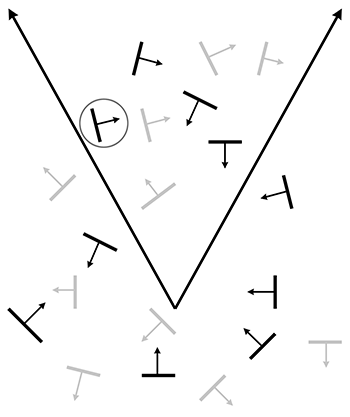

Figure 10.1 Les deux surfaces reçoivent des faisceaux de lumière identiques, mais la surface du bas a une plus grande aire, et a donc une irradiance plus faible.

En mesurant la radiance par unité d’angle solide, nous pouvons exprimer l’intensité de la lumière en un certain point comme une fonction qui varie en fonction de la direction d’incidence. Nous sommes très proches d’avoir l’unité de mesure qui décrit l’intensité d’un rayon. Il y a juste un léger problème, illustré par la Figure 10.1, qui est un gros plan d’un très mince pinceau de rayons lumineux frappant une surface. En haut, les rayons frappent la surface perpendiculairement, et en bas, des rayons lumineux de même intensité frappent une surface différente à un angle. Le point clé est que l’aire de la surface supérieure est plus petite que l’aire de la surface inférieure ; par conséquent, l’irradiance sur la surface supérieure est plus grande que l’irradiance sur la surface inférieure, malgré le fait que les deux surfaces sont éclairées par le « même nombre » de rayons lumineux identiques. Ce phénomène de base, selon lequel l’angle de la surface fait que les rayons lumineux incidents se dispersent et contribuent ainsi moins à l’irradiance, est connu sous le nom de loi de Lambert. Nous avons plus à dire sur la loi de Lambert à la Section 10.6.3, mais pour l’instant, l’idée clé est que la contribution d’un faisceau de lumière à l’irradiance sur une surface dépend de l’angle de cette surface.

En raison de la loi de Lambert, l’unité que nous utilisons en infographie pour mesurer l’intensité d’un rayon, la radiance, est définie comme le flux radiant par unité d’aire projetée, par unité d’angle solide. Pour mesurer une aire projetée, nous prenons l’aire de surface réelle et la projetons sur le plan perpendiculaire au rayon. (Dans la Figure 10.1, imaginez prendre la surface du bas et la projeter vers le haut sur la surface du haut). Cela contrebalance essentiellement la loi de Lambert.

La Table 10.1 résume les termes radiométriques les plus importants.

| Grandeur | Unités | Unité SI | Traduction approximative |

| Énergie rayonnante | Énergie | Illumination totale pendant un intervalle de temps | |

| Flux radiant | Puissance | Luminosité d’une aire finie dans toutes les directions | |

| Densité de flux radiant | Puissance par unité de surface | Luminosité d’un point unique dans toutes les directions | |

| Irradiance | Puissance par unité de surface | Densité de flux radiant de la lumière incidente | |

| Exitance rayonnante | Puissance par unité de surface | Densité de flux radiant de la lumière émise | |

| Radiosité | Puissance par unité de surface | Densité de flux radiant de la lumière émise ou réfléchie | |

| Radiance | Puissance par unité d’aire projetée, par unité d’angle solide | Luminosité d’un rayon |

Table 10.1Termes radiométriques courants

Alors que la radiométrie adopte le point de vue de la physique en mesurant l’énergie brute de la lumière, le domaine de la photométrie pondère cette même lumière en utilisant l’œil humain. Pour chacun des termes radiométriques correspondants, il existe un terme similaire en photométrie (Table 10.2). La seule vraie différence est une conversion non linéaire de l’énergie brute à la luminosité perçue.

| Terme radiométrique | Terme photométrique | Unité SI photométrique |

| Énergie rayonnante | Énergie lumineuse | talbot, ou lumen-seconde ( ) |

| Flux radiant | Flux lumineux, puissance lumineuse | lumen ( ) |

| Irradiance | Éclairement | lux ( ) |

| Exitance rayonnante | Exitance lumineuse | lux ( ) |

| Radiance | Luminance |

Table 10.2Unités de mesure de la radiométrie et de la photométrie

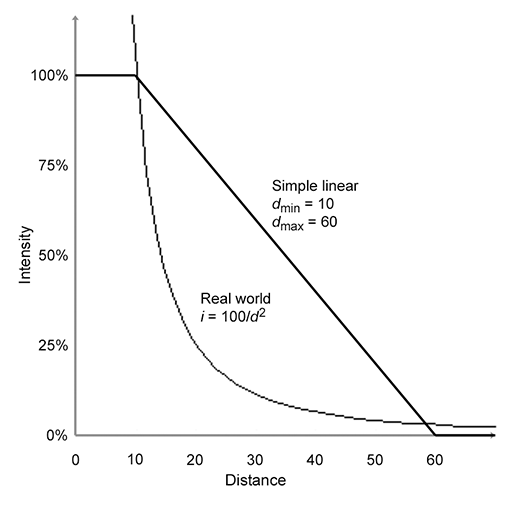

Tout au long du reste de ce chapitre, nous essayons d’utiliser les unités radiométriques appropriées quand c’est possible. Cependant, les réalités pratiques de l’infographie rendent l’utilisation d’unités appropriées confuse, pour deux raisons particulières. Il est courant en infographie d’avoir besoin d’effectuer une intégrale sur un « signal » — par exemple, la couleur d’une surface. En pratique, nous ne pouvons pas effectuer l’intégrale analytiquement, et nous devons donc l’intégrer numériquement, ce qui revient à prendre une moyenne pondérée de nombreux échantillons. Bien que mathématiquement nous prenons une moyenne pondérée (ce qui normalement ne causerait pas de changement d’unités), en fait ce que nous faisons c’est intégrer, et cela signifie que chaque échantillon est réellement multiplié par une quantité différentielle, comme une aire différentielle ou un angle solide différentiel, ce qui provoque un changement des unités physiques. Une deuxième source de confusion est que, bien que de nombreux signaux aient un domaine non nul fini dans le monde réel, ils sont représentés dans un ordinateur par des signaux qui sont non nuls en un seul point. (Mathématiquement, nous disons que le signal est un multiple d’un delta de Dirac ; voir la Section 12.4.3.) Par exemple, une source lumineuse du monde réel a une aire finie, et nous nous intéresserions à la radiance de la lumière en un point donné sur la surface émissive, dans une direction donnée. En pratique, nous imaginons réduire l’aire de cette lumière à zéro tout en maintenant le flux radiant constant. La densité de flux devient infinie en théorie. Ainsi, pour une lumière de surface réelle, nous aurions besoin d’un signal pour décrire la densité de flux, tandis que pour une lumière ponctuelle, la densité de flux devient infinie et nous décrivons à la place la luminosité de la lumière par son flux total. Nous répéterons ces informations lorsque nous parlerons des lumières ponctuelles.

Points clés sur la radiométrie

Les mots vagues tels que « intensité » et « luminosité » sont mieux évités lorsque les termes radiométriques plus spécifiques peuvent être utilisés. L’échelle de nos nombres n’est pas si importante et nous n’avons pas besoin d’utiliser des unités SI du monde réel, mais il est utile de comprendre ce que mesurent les différentes grandeurs radiométriques pour éviter de mélanger des grandeurs de façon inappropriée.

Utiliser le flux radiant pour mesurer la luminosité totale d’une aire finie, dans toutes les directions.

Utiliser la densité de flux radiant pour mesurer la luminosité en un seul point, dans toutes les directions. L’irradiance et l’exitance rayonnante désignent la densité de flux radiant de la lumière incidente et émise, respectivement. La radiosité est la densité de flux radiant de la lumière qui quitte une surface, qu’elle soit réfléchie ou émise.

En raison de la loi de Lambert, un rayon donné contribue davantage à l’irradiance différentielle lorsqu’il frappe une surface à un angle perpendiculaire par rapport à un angle rasant.

Utiliser la radiance pour mesurer la luminosité d’un rayon. Plus précisément, la radiance est le flux par unité d’angle projeté, par angle solide. Nous utilisons l’aire projetée de sorte que la valeur pour un rayon donné soit une propriété du rayon seul et ne dépende pas de l’orientation de la surface utilisée pour mesurer la densité de flux.

Les réalités pratiques contrecarrent nos meilleures intentions de faire les choses « correctement » en ce qui concerne l’utilisation d’unités appropriées. L’intégration numérique ressemble beaucoup à une prise de moyenne pondérée, ce qui cache le changement d’unités qui se produit réellement. Les lumières ponctuelles et autres deltas de Dirac ajoutent une confusion supplémentaire.

10.1.4L’équation de rendu

Adaptons maintenant la BRDF à l’algorithme de rendu. À l’étape 2 de notre algorithme de rendu (Section 10.1), nous essayons de déterminer la radiance quittant une surface particulière dans la direction de notre œil. La seule façon pour que cela se produise est que la lumière arrive depuis une certaine direction sur la surface et soit réfléchie dans notre direction. Avec la BRDF, nous avons maintenant un moyen de mesurer cela. Considérons toutes les directions potentielles depuis lesquelles la lumière pourrait être incidente sur la surface, qui forment un hémisphère centré en , orienté selon la normale de surface locale . Pour chaque direction potentielle , nous mesurons la couleur de la lumière incidente depuis cette direction. La BRDF nous indique quelle fraction de la radiance provenant de est réfléchie dans la direction vers notre œil (par opposition à dispersée dans une autre direction ou absorbée). En sommant la radiance réfléchie vers sur toutes les directions incidentes possibles, nous obtenons la radiance totale réfléchie le long de dans notre œil. Nous ajoutons la lumière réfléchie à toute lumière qui est émise par la surface dans notre direction (qui est nulle pour la plupart des surfaces), et voilà, nous avons la radiance totale. En notation mathématique, nous avons l’équation de rendu.

L’équation de rendu

Bien que l’Équation (10.1) soit aussi fondamentale qu’elle puisse l’être, son développement est relativement récent, ayant été publié au SIGGRAPH en 1986 par Kajiya [13]. De plus, c’était le résultat de, plutôt que la cause de, nombreuses stratégies pour produire des images réalistes. Les chercheurs en infographie ont poursuivi la création d’images par différentes techniques qui leur semblaient logiques avant d’avoir un cadre pour décrire le problème qu’ils essayaient de résoudre. Et pendant de nombreuses années après cela, la plupart d’entre nous dans l’industrie des jeux vidéo ignoraient que le problème que nous essayions de résoudre avait finalement été clairement défini. (Beaucoup le sont encore.)

Maintenant, traduisons cette équation en langage courant et voyons ce qu’elle signifie. Premièrement, remarquez que et apparaissent dans chaque fonction. Toute l’équation régit un équilibre de radiance en un seul point de surface pour une seule longueur d’onde (« canal de couleur ») . Donc cette équation d’équilibre s’applique à chaque canal de couleur individuellement, en tous les points de surface simultanément.

Le terme du côté gauche du signe d’égalité est simplement « la radiance quittant le point dans la direction ». Bien sûr, si est la surface visible à un pixel donné, et est la direction de vers l’œil, alors cette grandeur est exactement ce dont nous avons besoin pour déterminer la couleur du pixel. Mais notez que l’équation est plus générale, nous permettant de calculer la radiance sortante dans toute direction arbitraire et pour tout point donné , que pointe ou non vers notre œil.

Du côté droit, nous avons une somme. Le premier terme de la somme est « la radiance émise par dans la direction » et sera non nulle uniquement pour les surfaces émissives spéciales. Le deuxième terme, l’intégrale, est « la lumière réfléchie par dans la direction de ». Ainsi, d’un point de vue général, l’équation de rendu semblerait énoncer la relation plutôt évidente

Maintenant, disséquons cette intégrale intimidante. (Au fait, si vous n’avez pas eu de calcul et n’avez pas encore lu le Chapitre 11, remplacez simplement le mot « intégrale » par « somme », et vous ne manquerez pas l’essentiel de cette section.) Nous avons en fait déjà discuté de son fonctionnement lorsque nous avons parlé de la BRDF, mais répétons-le avec des mots différents. Nous pourrions réécrire l’intégrale comme

Notez que le symbole (oméga grec majuscule) apparaît là où nous écririons normalement les bornes d’intégration. Il est censé signifier « sommer sur l’hémisphère des directions entrantes possibles ». Pour chaque direction entrante , nous déterminons quelle radiance était incidente dans cette direction entrante et a été dispersée dans la direction sortante . La somme de toutes ces contributions provenant de toutes les différentes directions incidentes donne la radiance totale réfléchie dans la direction . Bien sûr, il y a un nombre infini de directions incidentes, c’est pourquoi il s’agit d’une intégrale. En pratique, nous ne pouvons pas évaluer l’intégrale analytiquement, et nous devons échantillonner un nombre discret de directions, transformant le « » en « ».

Il nous reste maintenant à disséquer l’intégrande. C’est un produit de trois facteurs :

Le premier facteur désigne la radiance incidente depuis la direction de . Le facteur suivant est simplement la BRDF, qui nous indique quelle fraction de la radiance incidente depuis cette direction particulière sera réfléchie dans la direction sortante qui nous intéresse. Finalement, nous avons le facteur de Lambert. Comme discuté à la Section 10.1.2, cela rend compte du fait que davantage de lumière incidente est disponible pour être réfléchie, par unité de surface, lorsque est perpendiculaire à la surface que lorsqu’il est à un angle rasant. Le vecteur est la normale de surface dirigée vers l’extérieur ; le produit scalaire atteint son maximum de 1 dans la direction perpendiculaire et diminue jusqu’à zéro à mesure que l’angle d’incidence devient plus rasant. Nous rediscutons du facteur de Lambert à la Section 10.6.3.

En termes purement mathématiques, l’équation de rendu est une équation intégrale : elle énonce une relation entre une fonction inconnue , la distribution de la lumière sur les surfaces de la scène, en termes de sa propre intégrale. Il peut ne pas être évident que l’équation de rendu soit récursive, mais apparaît en fait des deux côtés du signe d’égalité. Il apparaît dans l’évaluation de , qui est précisément l’expression que nous cherchons à résoudre pour chaque pixel : quelle est la radiance incidente sur un point depuis une direction donnée ? Ainsi, pour trouver la radiance quittant un point , nous devons connaître toute la radiance incidente en depuis toutes les directions. Mais la radiance incidente sur est la même que la radiance quittant toutes les autres surfaces visibles depuis , dans la direction pointant de l’autre surface vers .

Pour rendre une scène de manière réaliste, nous devons résoudre l’équation de rendu, ce qui nous oblige à connaître (en théorie) non seulement la radiance arrivant à la caméra, mais aussi toute la distribution de la radiance dans la scène dans chaque direction en chaque point. Clairement, c’est trop demander à un ordinateur digital fini, car l’ensemble des emplacements de surface et l’ensemble des directions incidentes/sortantes potentielles sont infinis. Le véritable art dans la création de logiciels pour la synthèse d’images numériques consiste à allouer le temps de traitement et la mémoire limités de la façon la plus efficace possible, pour faire la meilleure approximation possible.

Le pipeline de rendu simple que nous présentons à la Section 10.10 ne tient compte que de la lumière directe. Il ne tient pas compte de la lumière indirecte qui a rebondi sur une surface et est arrivée sur une autre. En d’autres termes, il ne fait qu’un « niveau de récursion » dans l’équation de rendu. Une composante immense des images réalistes est de tenir compte de la lumière indirecte — résoudre l’équation de rendu plus complètement. Les diverses méthodes pour accomplir cela sont connues sous le nom de techniques d’illumination globale.

Ceci conclut notre présentation de haut niveau du fonctionnement de l’infographie. Bien que nous admettions ne pas encore avoir présenté une seule idée pratique, nous pensons qu’il est très important de comprendre ce que vous essayez d’approximer avant de commencer à l’approximer. Même si les compromis que nous sommes forcés de faire pour le temps réel sont assez sévères, la puissance de calcul disponible augmente. Un programmeur de jeux vidéo dont la seule exposition à l’infographie a été des tutoriels OpenGL ou des démos faites par des fabricants de cartes graphiques ou des livres axés exclusivement sur le rendu en temps réel aura beaucoup plus de difficultés à comprendre même les techniques d’illumination globale d’aujourd’hui, et encore moins celles de demain.

10.2Visualisation en 3D

Avant de rendre une scène, nous devons choisir une caméra et une fenêtre. C’est-à-dire que nous devons décider depuis où la rendre (la position, l’orientation et le zoom de la vue) et vers où la rendre (le rectangle sur l’écran). La fenêtre de sortie est la plus simple des deux, et nous la discuterons donc en premier.

La Section 10.2.1 décrit comment spécifier la fenêtre de sortie. La Section 10.2.2 discute du rapport d’aspect des pixels. La Section 10.2.3 introduit le tronc de vue (view frustum). La Section 10.2.4 décrit les angles de champ de vision et le zoom.

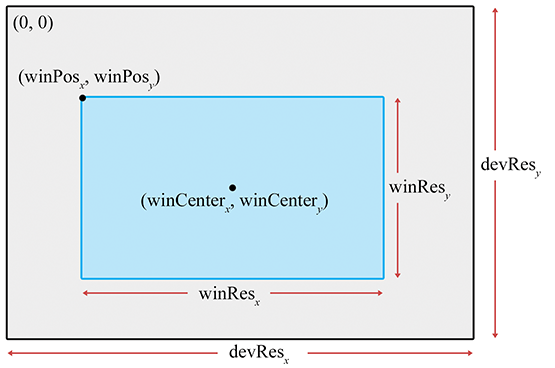

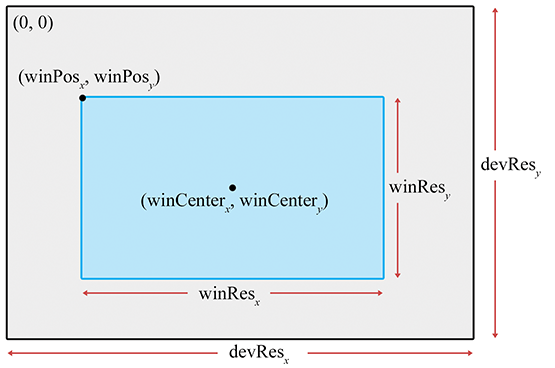

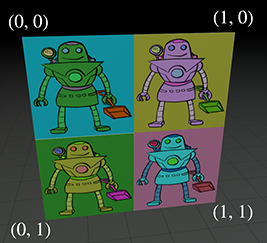

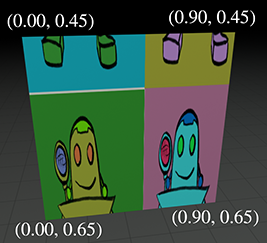

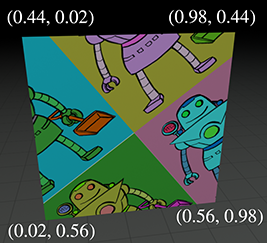

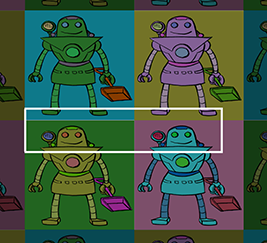

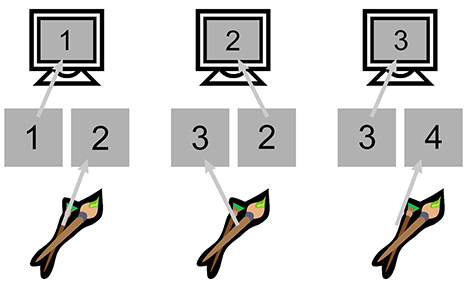

Figure 10.2Spécification de la fenêtre de sortie

10.2.1Spécification de la fenêtre de sortie

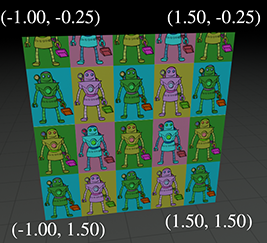

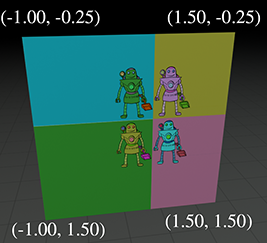

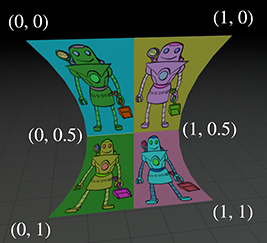

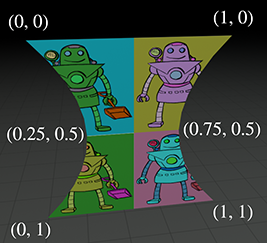

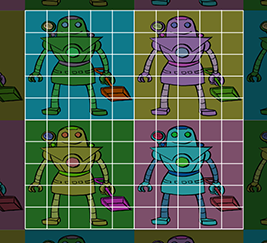

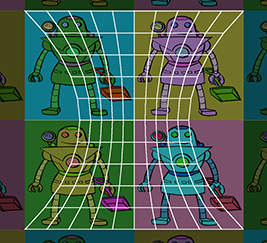

Nous n’avons pas à rendre notre image sur tout l’écran. Par exemple, dans les jeux multijoueurs en écran partagé, chaque joueur reçoit une portion de l’écran. La fenêtre de sortie désigne la portion du dispositif de sortie où notre image sera rendue. C’est illustré dans la Figure 10.2.

La position de la fenêtre est spécifiée par les coordonnées du pixel en haut à gauche . Les entiers et sont les dimensions de la fenêtre en pixels. La définir de cette façon, en utilisant la taille de la fenêtre plutôt que les coordonnées du coin inférieur droit, évite certaines questions épineuses causées par les coordonnées de pixels entières. Nous faisons également attention à distinguer entre la taille de la fenêtre en pixels et la taille physique de la fenêtre. Cette distinction deviendra importante à la Section 10.2.2.

Cela dit, il est important de réaliser que nous n’avons pas nécessairement besoin de rendre sur l’écran du tout. Nous pourrions rendre dans un tampon à sauvegarder dans un fichier .TGA ou en tant que trame dans un .AVI, ou nous pourrions rendre dans une texture comme sous-processus du rendu « principal », pour produire une carte d’ombres, un reflet, ou l’image sur un moniteur dans le monde virtuel. Pour ces raisons, le terme cible de rendu (render target) est souvent utilisé pour désigner la destination actuelle de la sortie de rendu.

10.2.2Rapport d’aspect des pixels

Que nous rendions sur l’écran ou dans un tampon hors-écran, nous devons connaître le rapport d’aspect des pixels, qui est le rapport de la hauteur d’un pixel à sa largeur. Ce rapport est souvent 1:1 — c’est- à-dire, nous avons des pixels « carrés » — mais ce n’est pas toujours le cas ! Nous donnons quelques exemples ci-dessous, mais il est courant que cette hypothèse passe sans être remise en question et devienne la source de correctifs compliqués appliqués au mauvais endroit, pour corriger des images étirées ou écrasées.

La formule pour calculer le rapport d’aspect est

Calcul du rapport d’aspect des pixels

La notation désigne la taille physique d’un pixel, et est la hauteur et la largeur physiques du dispositif sur lequel l’image est affichée. Pour les deux grandeurs, les mesures individuelles peuvent être inconnues, mais ce n’est pas grave car le rapport est tout ce dont nous avons besoin, et celui-ci est généralement connu. Par exemple, les moniteurs de bureau standards sont de toutes sortes de tailles, mais la zone visible de nombreux anciens moniteurs a un rapport de 4:3, ce qui signifie qu’elle est 33% plus large que haute. Un autre rapport courant est 16:9 ou plus large7 sur les téléviseurs haute définition. Les entiers et sont le nombre de pixels dans les dimensions et . Par exemple, une résolution de signifie que et .

Mais, comme déjà mentionné, nous traitons souvent des pixels carrés avec un rapport d’aspect de 1:1. Par exemple, sur un moniteur de bureau avec un rapport largeur:hauteur physique de 4:3, certaines résolutions courantes donnant des rapports de pixels carrés sont , , et . Sur les moniteurs 16:9, les résolutions courantes sont , , . Le rapport d’aspect 8:5 (plus communément connu sous le nom de 16:10) est aussi très courant, pour les tailles de moniteurs de bureau et de téléviseurs. Certaines résolutions d’affichage courantes en 16:10 sont , , , et . En fait, sur PC, il est courant d’assumer simplement un rapport de pixels de 1:1, car il peut être impossible d’obtenir les dimensions du dispositif d’affichage. Les jeux sur console ont la tâche plus facile à cet égard.

Notez que nulle part dans ces calculs la taille ou l’emplacement de la fenêtre n’est utilisé ; l’emplacement et la taille de la fenêtre de rendu n’ont aucune incidence sur les proportions physiques d’un pixel. Cependant, la taille de la fenêtre deviendra importante lorsque nous discuterons du champ de vision à la Section 10.2.4, et la position est importante lorsque nous passons de l’espace caméra à l’espace écran à la Section 10.3.5.

À ce stade, certains lecteurs pourraient se demander en quoi cette discussion a du sens dans le contexte du rendu sur un bitmap, où le mot « physique » impliqué par les noms de variables et ne s’applique pas. Dans la plupart de ces situations, il est approprié d’agir simplement comme si le rapport d’aspect des pixels était de 1:1. Dans certaines circonstances particulières, cependant, vous pourriez vouloir rendre anamorphiquement, produisant une image écrasée dans le bitmap qui sera ensuite étirée lorsque le bitmap est utilisé.

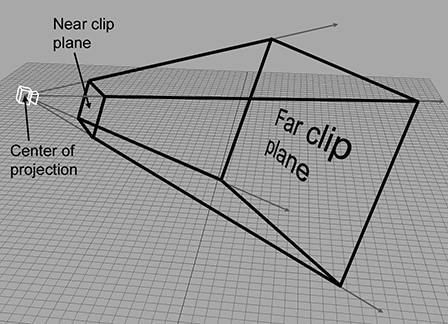

10.2.3Le tronc de vue

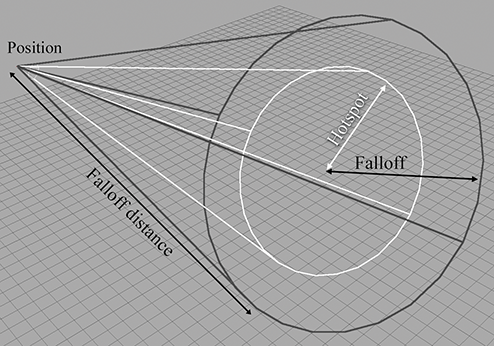

Le tronc de vue (view frustum) est le volume de l’espace potentiellement visible pour la caméra. Il a la forme d’une pyramide avec la pointe coupée. Un exemple de tronc de vue est montré dans la Figure 10.3.

Figure 10.3Le tronc de vue 3D

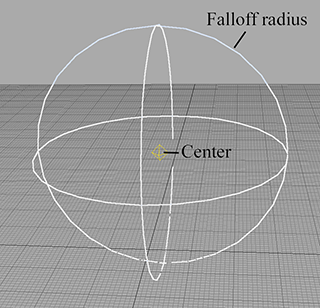

Le tronc de vue est délimité par six plans, connus sous le nom de plans de découpe (clip planes). Les quatre premiers plans forment les côtés de la pyramide et sont appelés les plans supérieur, gauche, inférieur et droit, pour des raisons évidentes. Ils correspondent aux côtés de la fenêtre de sortie. Les plans de découpe proche et lointain, qui correspondent à certaines valeurs de l’espace caméra, nécessitent un peu plus d’explication.

La raison du plan de découpe lointain est peut-être plus facile à comprendre. Il empêche le rendu des objets au-delà d’une certaine distance. Il y a deux raisons pratiques pour lesquelles un plan de découpe lointain est nécessaire. La première est relativement facile à comprendre : un plan de découpe lointain peut limiter le nombre d’objets à rendre dans un environnement extérieur. La deuxième raison est légèrement plus compliquée, mais essentiellement elle a à voir avec la façon dont les valeurs du tampon de profondeur sont attribuées. Par exemple, si les entrées du tampon de profondeur sont en virgule fixe sur 16 bits, alors la valeur de profondeur maximale pouvant être stockée est 65 535. La découpe lointaine établit quelle valeur (en virgule flottante) de dans l’espace caméra correspondra à la valeur maximale pouvant être stockée dans le tampon de profondeur. La motivation pour le plan de découpe proche devra attendre jusqu’à ce que nous discutions de l’espace de découpe (clip space) à la Section 10.3.2.

Notez que chacun des plans de découpe sont des plans, en insistant sur le fait qu’ils s’étendent à l’infini. Le volume de vue est l’intersection des six demi-espaces définis par les plans de découpe.

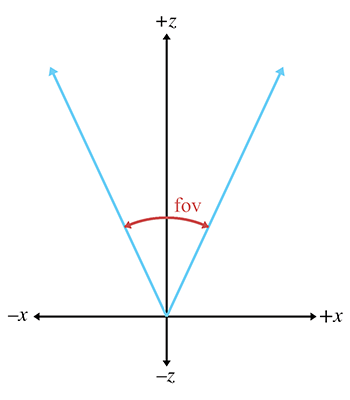

10.2.4Champ de vision et zoom

Une caméra a une position et une orientation, tout comme tout autre objet dans le monde. Cependant, elle a également une propriété supplémentaire connue sous le nom de champ de vision (field of view). Un autre terme que vous connaissez probablement est le zoom. Intuitivement, vous savez déjà ce que signifie « zoomer en avant » et « zoomer en arrière ». Lorsque vous zoomez en avant, l’objet que vous regardez semble plus grand à l’écran, et lorsque vous zoomez en arrière, la taille apparente de l’objet est plus petite. Voyons si nous pouvons développer cette intuition en une définition plus précise.

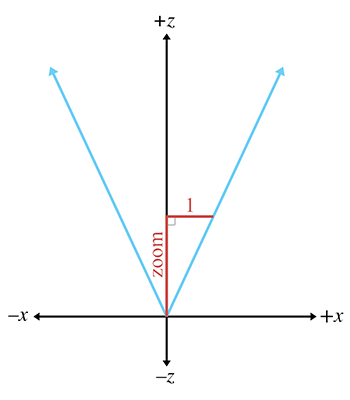

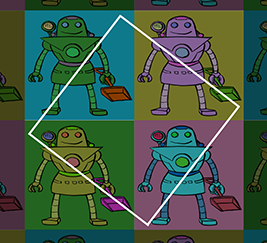

Le champ de vision (CDV ou FOV) est l’angle intercepté par le tronc de vue. Nous avons en réalité besoin de deux angles : un champ de vision horizontal et un champ de vision vertical. Revenons brièvement en 2D et considérons seulement l’un de ces angles. La Figure 10.4 montre le tronc de vue vu de dessus, illustrant précisément l’angle que mesure le champ de vision horizontal. L’étiquetage des axes illustre l’espace caméra, discuté à la Section 10.3.

Figure 10.4Champ de vision horizontal

Figure 10.5Interprétation géométrique du zoom

Le zoom mesure le rapport de la taille apparente de l’objet par rapport à un champ de vision de . Par exemple, un zoom de 2,0 signifie que l’objet apparaîtra deux fois plus grand à l’écran qu’avec un champ de vision de . Donc des valeurs de zoom plus grandes font que l’image à l’écran devient plus grande (« zoom avant »), et des valeurs de zoom plus petites font que les images à l’écran deviennent plus petites (« zoom arrière »).

Le zoom peut être interprété géométriquement comme le montre la Figure 10.5. En utilisant quelques trigonométries de base, nous pouvons dériver la conversion entre zoom et champ de vision :

Conversion entre zoom et champ de vision

Notez la relation inverse entre zoom et champ de vision. À mesure que le zoom augmente, le champ de vision diminue, faisant se rétrécir le tronc de vue. Cela peut ne pas sembler intuitif au premier abord, mais lorsque le tronc de vue se rétrécit, la taille perçue des objets visibles augmente.

Le champ de vision est une mesure commode pour les humains, mais comme nous le découvrons à la Section 10.3.4, le zoom est la mesure dont nous avons besoin pour alimenter le pipeline graphique.

Nous avons besoin de deux angles de champ de vision différents (ou valeurs de zoom), un horizontal et un vertical. Nous sommes certainement libres de choisir deux valeurs arbitraires, mais si nous ne maintenons pas une relation appropriée entre ces valeurs, l’image rendue semblera étirée. Si vous avez déjà regardé un film destiné à l’écran large qui a simplement été écrasé anamorphiquement pour tenir sur un téléviseur normal, ou regardé du contenu 4:3 sur un téléviseur 16:9 en mode « plein »8, alors vous avez vu cet effet.

Pour maintenir des proportions correctes, les valeurs de zoom doivent être inversement proportionnelles aux dimensions physiques de la fenêtre de sortie :

La relation habituelle entre le zoom vertical et horizontal

La variable désigne la taille physique de la fenêtre de sortie. Comme indiqué dans l’Équation (10.4), même si nous ne connaissons généralement pas la taille réelle de la fenêtre de rendu, nous pouvons déterminer son rapport d’aspect. Mais comment faire ? En général, tout ce que nous connaissons est la résolution (nombre de pixels) de la fenêtre de sortie. C’est là que les calculs de rapport d’aspect des pixels de la Section 10.2.2 entrent en jeu :

Dans cette formule,

désigne les valeurs de zoom de la caméra,

désigne la taille physique de la fenêtre,

désigne la résolution de la fenêtre, en pixels,

désigne les dimensions physiques d’un pixel,

désigne les dimensions physiques du dispositif de sortie. Rappelons que nous ne connaissons généralement pas les tailles individuelles, mais nous connaissons le rapport,

désigne la résolution du dispositif de sortie.

De nombreux packages de rendu vous permettent de spécifier seulement un angle de champ de vision (ou une valeur de zoom). Lorsque vous faites cela, ils calculent automatiquement l’autre valeur pour vous, en supposant que vous voulez des proportions d’affichage uniformes. Par exemple, vous pouvez spécifier le champ de vision horizontal, et ils calculent le champ de vision vertical pour vous.

Maintenant que nous savons comment décrire le zoom d’une manière adaptée à un ordinateur, que faisons-nous de ces valeurs de zoom ? Elles entrent dans la matrice de découpe (clip matrix), décrite à la Section 10.3.4.

10.2.5Projection orthographique

La discussion jusqu’à présent a porté sur la projection en perspective, qui est le type de projection le plus couramment utilisé, car c’est ainsi que nos yeux perçoivent le monde. Cependant, dans de nombreuses situations, la projection orthographique est également utile. Nous avons introduit la projection orthographique à la Section 5.3 ; pour rappeler brièvement, en projection orthographique, les lignes de projection (les lignes qui relient tous les points de l’espace qui se projettent sur les mêmes coordonnées d’écran) sont parallèles, plutôt que de se croiser en un seul point. Il n’y a pas de raccourcissement de perspective en projection orthographique ; un objet apparaîtra à la même taille à l’écran quelle que soit sa distance, et déplacer la caméra en avant ou en arrière selon la direction de visualisation n’a aucun effet apparent tant que les objets restent devant le plan de découpe proche.

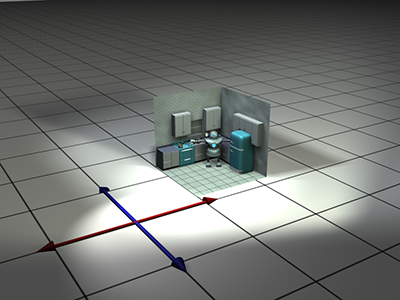

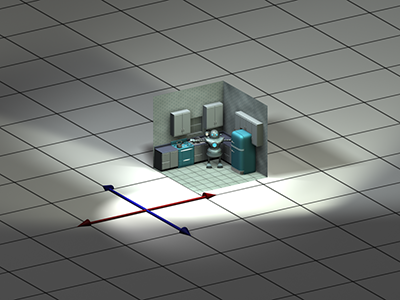

La Figure 10.6 montre une scène rendue depuis la même position et orientation, en comparant la projection en perspective et la projection orthographique. À gauche, notez qu’avec la projection en perspective, les lignes parallèles ne restent pas parallèles, et les carrés de la grille plus proches sont plus grands que ceux dans le fond. Avec la projection orthographique, les carrés de la grille ont tous la même taille et les lignes de la grille restent parallèles.

|

|

| Projection en perspective | Projection orthographique |

Figure 10.6Projection en perspective versus orthographique

Les vues orthographiques sont très utiles pour les vues « schématiques » et d’autres situations où les distances et les angles doivent être mesurés avec précision. Tout outil de modélisation supportera ce type de vue. Dans un jeu vidéo, vous pourriez utiliser une vue orthographique pour rendre une carte ou un autre élément HUD.

Pour une projection orthographique, il n’est pas logique de parler du « champ de vision » comme d’un angle, car le tronc de vue a la forme d’une boîte, pas d’une pyramide. Plutôt que de définir les dimensions et du tronc de vue en termes de deux angles, nous donnons deux tailles : la largeur et la hauteur physiques de la boîte.

La valeur de zoom a une signification différente en projection orthographique par rapport à la perspective. Elle est liée à la taille physique de la boîte du tronc :

Conversion entre zoom et taille du tronc en projection orthographique

Comme pour les projections en perspective, il y a deux valeurs de zoom différentes, une pour et une pour , et leur rapport doit être coordonné avec le rapport d’aspect de la fenêtre de rendu pour éviter de produire une image « écrasée ». Nous avons développé l’Équation (10.5) avec la projection en perspective en tête, mais cette formule régit également la relation appropriée pour la projection orthographique.

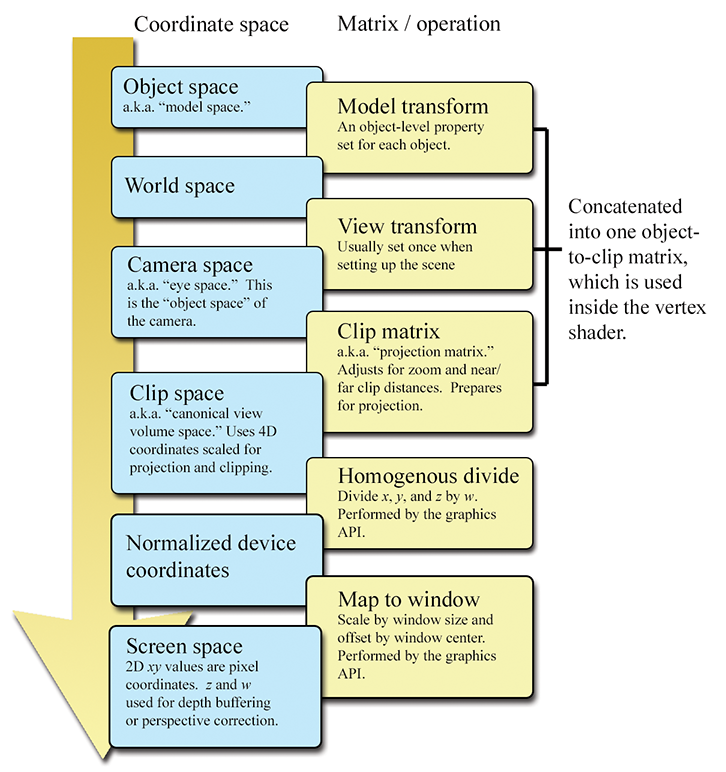

10.3Espaces de coordonnées

Cette section passe en revue plusieurs espaces de coordonnées importants liés à la visualisation 3D. Malheureusement, la terminologie n’est pas cohérente dans la littérature sur le sujet, même si les concepts le sont. Ici, nous discutons des espaces de coordonnées dans l’ordre dans lequel ils sont rencontrés au fur et à mesure que la géométrie circule dans le pipeline graphique.

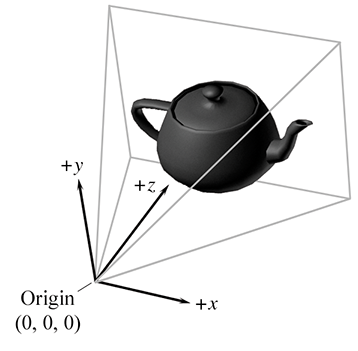

10.3.1Espace modèle, monde et caméra

La géométrie d’un objet est initialement décrite dans l’espace objet, qui est un espace de coordonnées local à l’objet décrit (voir la Section 3.2.2). L’information décrite consiste généralement en des positions de sommets et des normales de surface. L’espace objet est également connu sous le nom d’espace local et, surtout dans le contexte de l’infographie, d’espace modèle.

Depuis l’espace modèle, les sommets sont transformés dans l’espace monde (voir la Section 3.2.1). La transformation de l’espace de modélisation vers l’espace monde est souvent appelée la transformation modèle. Typiquement, l’éclairage de la scène est spécifié dans l’espace monde, bien que, comme nous le voyons à la Section 10.11, cela n’ait pas vraiment d’importance quel espace de coordonnées est utilisé pour effectuer les calculs d’éclairage, à condition que la géométrie et les lumières puissent être exprimées dans le même espace.

Depuis l’espace monde, les sommets sont transformés par la transformation vue dans l’espace caméra (voir la Section 3.2.3), également connu sous le nom d’espace œil et d’espace vue (à ne pas confondre avec l’espace volume de vue canonique, discuté plus loin). L’espace caméra est un espace de coordonnées 3D dans lequel l’origine est au centre de projection, un axe est parallèle à la direction vers laquelle la caméra pointe (perpendiculaire au plan de projection), un axe est l’intersection des plans de découpe supérieur et inférieur, et l’autre axe est l’intersection des plans de découpe gauche et droit. Si nous adoptons la perspective de la caméra, alors un axe sera « horizontal » et un sera « vertical ».

Dans un monde à main gauche, la convention la plus courante est que pointe dans la direction vers laquelle la caméra fait face, avec et pointant vers la « droite » et vers le « haut » (toujours depuis la perspective de la caméra). C’est assez intuitif, comme le montre la Figure 10.7. La convention typique à main droite est que pointe dans la direction vers laquelle la caméra fait face. Nous supposons les conventions à main gauche pour le reste de ce chapitre.

Figure 10.7Conventions typiques de l’espace caméra pour les systèmes de coordonnées à main gauche

10.3.2Espace de découpe et matrice de découpe

Depuis l’espace caméra, les sommets sont transformés à nouveau dans l’espace de découpe (clip space), également connu sous le nom d’espace volume de vue canonique. La matrice qui transforme les sommets de l’espace caméra en espace de découpe est appelée la matrice de découpe (clip matrix), également connue sous le nom de matrice de projection.

Jusqu’à présent, nos positions de sommets étaient des vecteurs 3D « purs » — c’est-à-dire qu’ils n’avaient que trois coordonnées, ou s’ils avaient une quatrième coordonnée, alors était toujours égal à 1 pour les vecteurs de position et 0 pour les vecteurs de direction tels que les normales de surface. (Dans certaines situations particulières, nous pourrions utiliser des transformations plus exotiques, mais la plupart des transformations de base sont des transformations affines 3D.) La matrice de découpe, cependant, met des informations significatives dans . La matrice de découpe remplit deux fonctions principales :

Préparer la projection. Nous mettons la valeur appropriée dans de sorte que la division homogène produise la projection souhaitée. Pour la projection en perspective typique, cela signifie que nous copions dans . Nous en parlons à la Section 10.3.3.

Appliquer le zoom et préparer le découpage. Nous mettons à l’échelle , et de sorte qu’ils puissent être comparés à pour le découpage. Cette mise à l’échelle tient compte des valeurs de zoom de la caméra, car ces valeurs de zoom affectent la forme du tronc de vue contre lequel le découpage se produit. Ceci est discuté à la Section 10.3.4.

10.3.3La matrice de découpe : préparer la projection

Rappelons d’après la Section 6.4.1 qu’un vecteur homogène 4D est mappé sur le vecteur physique 3D correspondant en divisant par :

Conversion de coordonnées homogènes 4D en 3D

Le premier objectif de la matrice de découpe est d’obtenir la valeur correcte dans de sorte que cette division provoque la projection souhaitée (perspective ou orthographique). C’est la raison pour laquelle cette matrice est parfois appelée matrice de projection, bien que ce terme soit un peu trompeur — la projection n’a pas lieu lors de la multiplication par cette matrice, elle se produit lorsque nous divisons , et par .

Si c’était le seul but de la matrice de découpe, de placer la valeur correcte dans , la matrice de découpe pour la projection en perspective serait simplement

Une matrice triviale pour définir , pour la projection en perspective

En multipliant un vecteur de la forme par cette matrice, puis en effectuant la division homogène par , on obtient

À ce stade, de nombreux lecteurs pourraient raisonnablement poser deux questions. La première question pourrait être : « Pourquoi est-ce si compliqué ? Cela semble beaucoup de travail pour accomplir ce qui revient essentiellement à diviser par . » Vous avez raison. Dans de nombreux anciens rastériseurs logiciels, où les mathématiques de projection étaient codées à la main, n’apparaissait nulle part, et il y avait juste une division explicite par . Alors pourquoi tolérons-nous toute cette complication ? L’une des raisons pour les coordonnées homogènes est qu’elles peuvent représenter une gamme plus large de spécifications de caméra naturellement. À la fin de cette section, nous verrons comment les projections orthographiques peuvent être gérées facilement, sans l’« instruction if » qui était nécessaire dans les anciens systèmes codés à la main. Mais il existe d’autres types de projections qui sont également utiles et sont gérées naturellement dans ce cadre. Par exemple, les plans du tronc n’ont pas besoin d’être symétriques par rapport à la direction de visualisation, ce qui correspond à la situation où votre direction de vue ne passe pas par le centre de la fenêtre. Ceci est utile, par exemple, lors du rendu d’une image haute résolution en blocs plus petits, ou pour la division et la fusion dynamique sans rupture des vues en écran partagé. Un autre avantage de l’utilisation des coordonnées homogènes est qu’elles rendent le découpage en (contre les plans de découpe proche et lointain) identique au découpage en et en . Cette similitude rend les choses nettes et ordonnées, mais, plus important, sur certains matériels, l’unité vectorielle peut être exploitée pour effectuer des tests de comparaison de découpage en parallèle. En général, l’utilisation des coordonnées homogènes et des matrices rend les choses plus compactes et polyvalentes, et (dans l’esprit de certains) plus élégantes. Mais indépendamment de savoir si l’utilisation de matrices améliore le processus, c’est la façon dont la plupart des API veulent que les choses soient livrées, alors c’est ainsi que ça fonctionne, pour le meilleur ou pour le pire.

La deuxième question qu’un lecteur pourrait avoir est : « Qu’est-il arrivé à ? » Rappelons que est la distance focale, la distance du plan de projection au centre de projection (le « point focal »). Notre discussion de la projection en perspective via la division homogène à la Section 6.5 décrivait comment projeter sur un plan perpendiculaire à l’axe et à unités de l’origine. (Le plan est de la forme .) Mais nous n’avons pas utilisé dans la discussion ci-dessus. Il s’avère que la valeur que nous utilisons pour n’est pas importante, et donc nous choisissons la valeur la plus pratique possible pour , qui est 1.

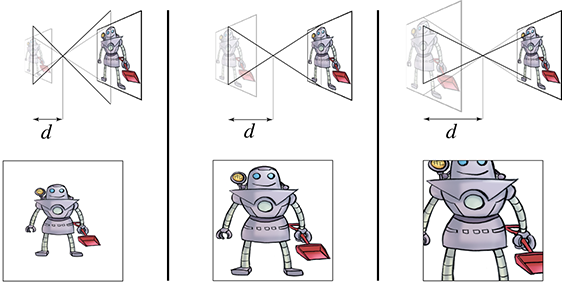

Pour comprendre pourquoi n’a pas d’importance, comparons la projection qui se produit dans un ordinateur avec la projection qui se produit dans une caméra physique. À l’intérieur d’une vraie caméra, augmenter cette distance fait zoomer la caméra en avant (les objets apparaissent plus grands), et la diminuer fait zoomer en arrière (les objets apparaissent plus petits). C’est montré dans la Figure 10.8.

Figure 10.8 Dans une caméra physique, augmenter la distance focale tout en gardant la taille du « film » identique a pour effet de zoomer en avant.

La ligne verticale à gauche de chaque diagramme représente le film (ou, pour les appareils photo modernes, l’élément de détection), qui se trouve dans le plan de projection infini. Notamment, remarquez que le film a la même hauteur dans chaque diagramme. À mesure que nous augmentons , le film s’éloigne davantage du plan focal, et l’angle du champ de vision intercepté par le tronc de vue diminue. À mesure que le tronc de vue se rétrécit, un objet à l’intérieur de ce tronc occupe une plus grande proportion du volume visible, et apparaît donc plus grand dans l’image projetée. Le résultat perçu est que nous zoomons en avant. Le point clé ici est que changer la longueur focale fait apparaître un objet plus grand parce que l’image projetée est plus grande par rapport à la taille du film.

Voyons maintenant ce qui se passe à l’intérieur d’un ordinateur. Le « film » à l’intérieur d’un ordinateur est la portion rectangulaire du plan de projection qui intersecte le tronc de vue.9 Remarquez que si nous augmentons la distance focale, la taille de l’image projetée augmente, tout comme dans une vraie caméra. Cependant, à l’intérieur d’un ordinateur, le film augmente réellement dans cette même proportion, plutôt que de changer la taille du tronc de vue. Parce que l’image projetée et le film augmentent dans la même proportion, il n’y a pas de changement dans l’image rendue ou la taille apparente des objets dans cette image.

En résumé, le zoom est toujours accompli en changeant la forme du tronc de vue, que nous parlions d’une vraie caméra ou d’un ordinateur. Dans une vraie caméra, changer la longueur focale modifie la forme du tronc de vue parce que le film reste de la même taille. Cependant, dans un ordinateur, ajuster la distance focale n’affecte pas l’image rendue, car le « film » augmente de taille et la forme du tronc de vue ne change pas.

Certains logiciels permettent à l’utilisateur de spécifier le champ de vision en donnant une longueur focale mesurée en millimètres. Ces chiffres sont en référence à une taille de film standard, presque toujours du film 35 mm.

Qu’en est-il de la projection orthographique ? Dans ce cas, nous ne voulons pas diviser par , donc notre matrice de découpe aura une colonne de droite de , identique à la matrice identité. Lorsque multipliée par un vecteur de la forme , cela donnera un vecteur avec , plutôt que . La division homogène se produit toujours, mais cette fois nous divisons par 1 :